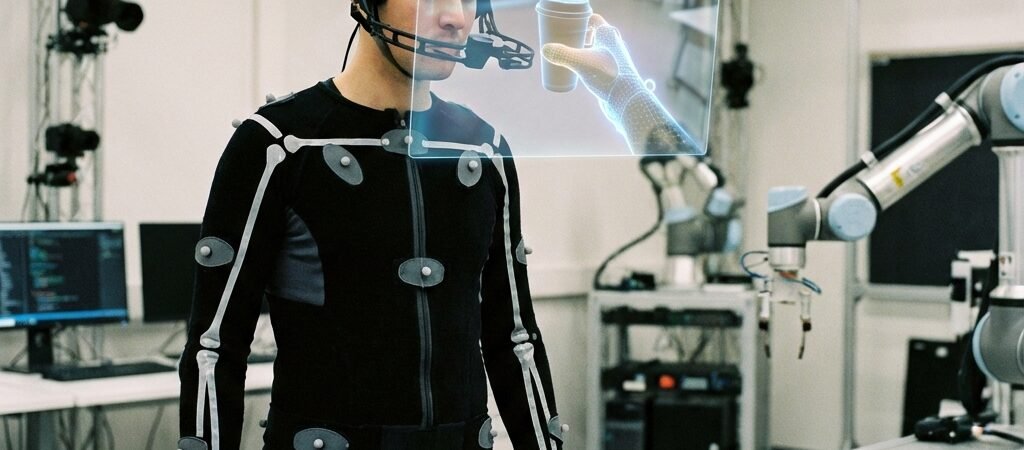

AI가 이제 단순한 제어 신호를 넘어, 인간의 전신 관절 움직임을 이해하고 그에 따른 미래의 시각적 결과를 직접 시뮬레이션하기 시작했습니다.

버클리 BAIR 연구진이 발표한 PEVA는 인간의 행동을 조건으로 미래 영상을 생성하는 ‘세계 모델(World Model)’로서, AI가 물리적 세계의 인과관계를 학습하는 방식에 새로운 획을 그었습니다.

로보틱스 및 확장 현실(XR) 분야의 기업들은 이러한 시각적 기획(Visual Planning) 기술을 도입하여, 시행착오를 최소화하고 보다 안전하며 고도화된 상호작용 시스템을 구축할 수 있습니다.

이 모델이 중요한 이유는 로봇이나 가상 비서가 단순한 명령 수행을 넘어, 자신이 취할 행동이 미래의 환경에 어떤 시각적 변화를 가져올지 미리 ‘상상’하고 계획할 수 있게 하기 때문입니다.

결국 AI는 물리 법칙과 인간의 의도를 결합한 통합적인 세계 시뮬레이터로 진화하며, 이는 자율 주행과 고지능 로봇 비서의 완성도를 비약적으로 높일 것입니다.

📎 참고자료

-

- 인간의 전신 움직임(Whole-Body Action)을 조건으로 1인칭 시점의 미래 영상을 생성하는 모델 제안

- 복잡한 실제 환경에서의 인간 행동 결과를 예측함으로써 로봇의 지능적 의사결정을 지원

- 단일 제어 신호가 아닌 관절 골격계 데이터를 기반으로 한 정밀한 시각적 미래 시뮬레이션 성공